Muszę przyznać, że na początku nie wierzyłem, że to jest możliwe.

Udało się nam skompresować nasz model AnonimiNER do 500 MB i załadować go do przeglądarki, gdzie działa w czasie rzeczywistym!

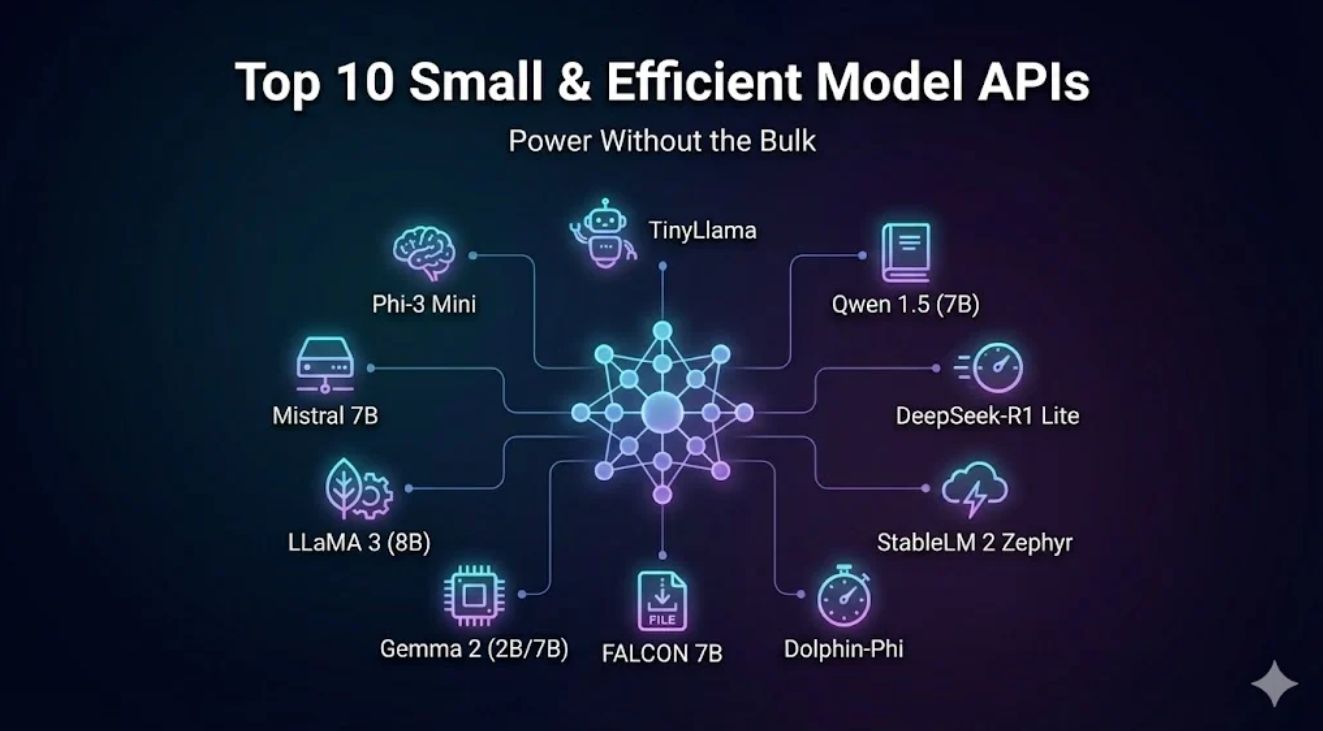

W czasach, kiedy nawet lokalne małe LLM-y zajmują po 48 GB i potrzebują dedykowanego GPU, większość osób zapomina, że można inaczej i że AI nie polega tylko na LLM-ach i że takie rzeczy można osiągnąć dedykowanymi modelami AI.

Jak to zrobiliśmy?

- Quantization Aware Traninig - model podczas treningu jest już przystosowywany do kwantyzacji INT4

Wykorzystanie najnowszych metod kwantyzacji - ParoQuant i dostosowanie ich do architektury modelu

- Modyfikacje funkcji błędu i agumentacje żeby model był bardziej odporny i mniej degradował

- Dedykowany eksporter ONNX z różną precyzją dla różnych warstwNie jest to 100% skuteczność naszego bazowego Anoniminera, ale spadki jakości są małe, a za to model może zawsze działać w tle w przeglądarce.

Na razie jest to zaknięta beta, ale mam nadzieję, że niedługo upublicznimy to szerzej.