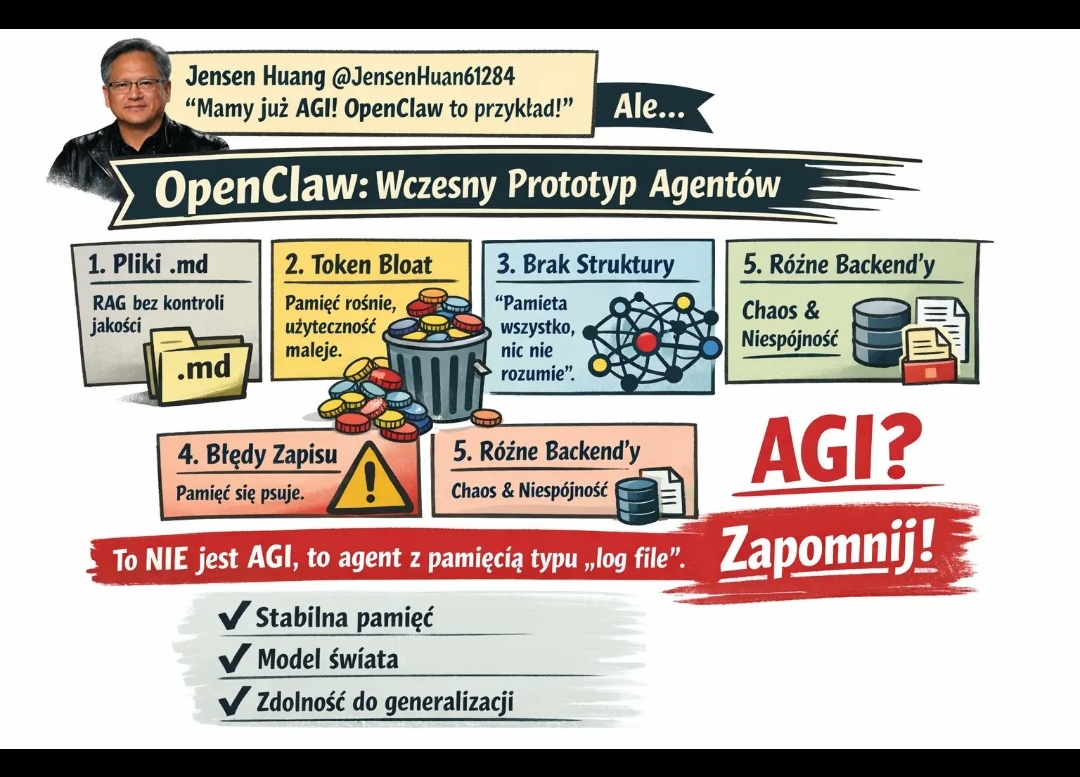

Jensen Huang @JensenHuan61284 ogłosił, że według pewnej definicji mamy już AGI, i wskazał OpenClaw jako konkretny przykład tego postępu.

Tylko, że OpenClaw to raczej jest „wczesny prototyp agentów".

1. OpenClaw trzyma pamięć długoterminową głównie jako zwykłe pliki .md. To jest w praktyce: RAG bez kontroli jakości.

2. Token bloat - im dłużej używasz, tym więcej śmieci w plikach. Model zaczyna dostawać ogromne, nieuporządkowane MD i albo zapomina kluczowe rzeczy, albo kosztuje masę tokenów. Czyli: pamięć rośnie liniowo, użyteczność maleje wykładniczo. To jest fundamentalny problem, nie bug.

3. Brak struktury - nie ma automatycznego podsumowywania, deduplikacji ani hierarchii. Po kilku tygodniach masz setki losowych wpisów i agent „pamięta wszystko, ale nie rozumie nic”. To jest po prostu 100 losowych tekstów a nie graf wiedzy.

4. Błędy zapisu - po update’ach często przestaje pisać do MD (lub w ogóle do pamięci). Jest masa GitHub issues o tym, że pamięć nagle się resetuje lub nie nadpisuje plików. System pamięci w OpenClaw nie jest deterministyczny.

5. Różne backendy - u jednego użytkownika wszystko idzie do SQLite z embeddingami, u drugiego tylko do codziennych MD – stąd chaos i niekonsekwentne zachowanie.W efekcie wielu ludzi po 1-2 tygodniach intensywnego używania narzeka, że agent staje się coraz głupszy, zapomina ustalenia i trzeba ręcznie sprzątać pliki.

Stwierdzenie, że to już AGI, jest tak idiotyczne, że szkoda to komentować.

AGI wymaga:

1. Stabilnej pamięci

2. Spójnego modelu świata

3. Zdolności do generalizacji

4 ...OpenClaw to nie jest AGI - to jest agent z pamięcią typu „log file".